- El nuevo robot está diseñado para coordinar tareas domésticas reales a través de electrodomésticos conectados

- CLOiD materializa la visión de “hogar sin trabajo” de LG y marca un nuevo punto de inflexión en la robótica inteligente

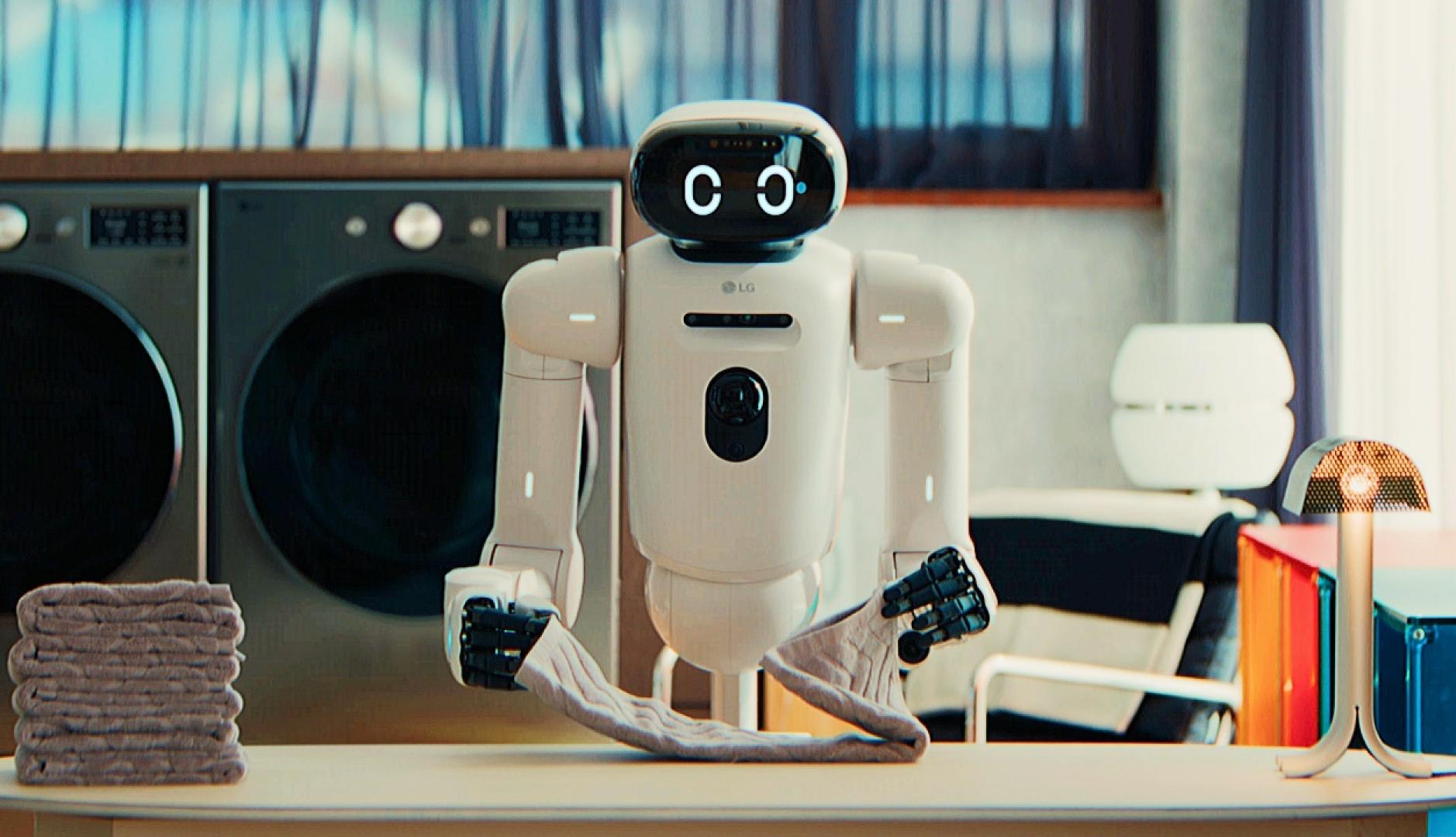

Durante el evento, LG ha mostrado a CLOiD operando en escenarios cotidianos. Así, el robot es capaz de preparar el desayuno interactuando con el frigorífico y el horno, iniciar ciclos de lavado cuando la vivienda queda vacía y gestionar el secado, doblado y apilado de la ropa. Más allá de la ejecución mecánica, CLOiD demuestra comprensión del contexto y del estilo de vida del usuario, actuando como un orquestador de tareas dentro del ecosistema de hogar conectado de LG.

En lo relativo al diseño de CLOiD, el robot está compuesto por una cabeza, un torso con dos brazos articulados y una base con ruedas dotada de navegación autónoma. Esta configuración prioriza estabilidad, seguridad y viabilidad económica frente a soluciones humanoides bípedas. Cada brazo dispone de siete grados de libertad y manos con cinco dedos accionados de forma independiente, lo que le permite manipular objetos cotidianos. El torso ajustable en altura amplía su rango de acción, mientras que la base de bajo centro de gravedad reduce riesgos en entornos con niños o mascotas.

El robot puede comunicarse con las personas mediante lenguaje natural y expresiones visuales

Por su parte, la cabeza de CLOiD funciona como un hub de IA móvil para el hogar. Integra pantalla, altavoz, cámaras, sensores y un chipset que combina IA generativa por voz con capacidades de aprendizaje continuo. Este conjunto permite al robot comunicarse con las personas mediante lenguaje natural y expresiones visuales, aprender patrones de uso y controlar electrodomésticos conectados en función de esos aprendizajes.

En el núcleo del sistema se encuentra la llamada IA Física de LG, que combina modelos de Lenguaje y Visión (VLM) -capaces de convertir imágenes y vídeo en comprensión estructurada- con modelos de Visión y Acción (VLA), que traducen esas entradas visuales y verbales en acciones físicas. Entrenados con decenas de miles de horas de datos de tareas domésticas, estos modelos permiten a CLOiD reconocer electrodomésticos, interpretar intenciones y ejecutar acciones coherentes con el contexto, como abrir puertas o desplazar objetos.

Artículo publicado en la web de Reason Why.